一、引言

在人工智能领域中,使机器能够理解和解释视觉世界一直是研究的热点。目标检测算法作为计算机视觉的一项核心技术,使得这一愿景逐渐变为现实。它不仅能精确识别图像中的物体,还能实现物体的定位,是自动驾驶、安全监控、医疗诊断等众多应用的基础。

二、目标检测算法概述

目标检测算法通过机器学习技术,尤其是深度学习,实现了对图像中特定对象的识别和定位。不同于简单的物体识别(只识别有什么物体),目标检测需要确定物体的位置(在哪里),通常以边界框的形式呈现。

三、基本术语和概念介绍

- 检出(Detection): 确定图像中是否存在特定对象。

- 定位(Localization): 确定这些对象在图像中的具体位置。

- 分类(Classification): 识别对象所属的类别。

四、检测方法

1. 传统方法

依赖于手工特征提取和传统分类器,如HOG+SVM。

2. 深度学习方法

- 基于区域提议:例如R-CNN系列,通过候选区域提取,再用卷积神经网络进行特征学习和分类。

- 基于回归:例如YOLO系列,将目标检测作为一个回归问题,直接在图像上预测边界框和类别概率。

- 基于分割:例如Mask R-CNN,不仅检测边界框,还能生成高精度的对象实例分割掩码。

五、关键技术和创新点

- 锚框与先验框技术:提高检测算法的效率和准确性。

- 特征金字塔网络(FPN):通过构建不同分辨率的特征图,改善了多尺度目标检测问题。

- 注意力机制:引入通道、空间或混合注意力机制,提升模型对重要特征的关注度。

- 损失函数设计:如焦点损失(Focal Loss)解决类别不平衡问题。

- 模型压缩与加速:通过剪枝、量化等技术,使模型更适用于移动或嵌入式设备。

六、必要的基础知识准备

- 图像处理基础:了解图像格式、编码和预处理技术。

- 机器学习与深度学习:掌握基本的机器学习算法和深度学习框架,特别是卷积神经网络(CNN)。

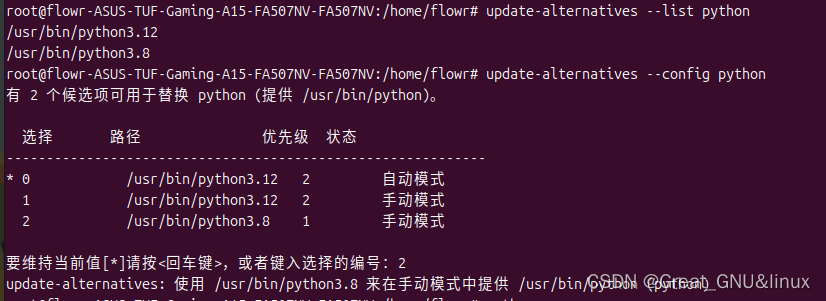

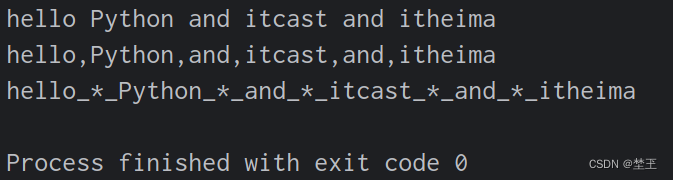

- 数学与编程:具备一定的数学理论基础和编程能力,Python是一个加分项。

七、实践项目与案例分析

目标检测是计算机视觉中的一个重要分支,旨在识别图像或视频帧中的特定对象及其位置。实践中,有许多流行的算法和框架可以用来实现目标检测,其中最著名的包括YOLO(You Only Look Once)、Faster R-CNN、Mask R-CNN等。下面我将以YOLOv5为例,简要介绍如何在一个实践项目中应用目标检测算法,并提供基本的代码示例。

环境准备

首先,确保你的环境已经安装了Python和以下必要的库:

- PyTorch

- torchvision

- yolov5

你可以使用pip安装yolov5(注意:此步骤可能需要从GitHub仓库直接克隆并安装):

git clone https://github.com/ultralytics/yolov5.git

cd yolov5

pip install -r requirements.txt # 安装所需依赖实践项目案例:行人检测

假设我们要在一个视频流中实时检测行人。以下是使用YOLOv5进行目标检测的基本代码示例:

代码示例

import torch

from yolov5.models.experimental import attempt_load

from yolov5.utils.datasets import LoadImages

from yolov5.utils.general import non_max_suppression, scale_coords

from yolov5.utils.torch_utils import select_device

from PIL import Image

import cv2

def detect_people_in_video(weights='yolov5s.pt', source='video.mp4'):

device = select_device('')

half = device.type != 'cpu' # half precision only supported on CUDA

# 加载模型

model = attempt_load(weights, map_location=device) # load FP32 model

stride = int(model.stride.max()) # model stride

imgsz = check_img_size(640, s=stride) # check img_size

# 获取视频流

cap = cv2.VideoCapture(source)

if not cap.isOpened():

print("Error opening video file")

exit()

while True:

ret, frame = cap.read()

if not ret:

break

# 将帧转换为RGB图像

img0 = frame[:, :, ::-1]

img = letterbox(img0, new_shape=imgsz)[0]

# 图像预处理

img = img[:, :, ::-1].transpose(2, 0, 1) # BGR to RGB, to 3x416x416

img = np.ascontiguousarray(img)

img = torch.from_numpy(img).to(device)

img = img.half() if half else img.float() # uint8 to fp16/32

img /= 255.0 # 0 - 255 to 0.0 - 1.0

if img.ndimension() == 3:

img = img.unsqueeze(0)

# 推理

pred = model(img)[0]

# 应用NMS

pred = non_max_suppression(pred, 0.25, 0.45, classes=None, agnostic=False)

# 处理预测框

for i, det in enumerate(pred): # detections per image

if len(det):

# Rescale boxes from img_size to im0 size

det[:, :4] = scale_coords(img.shape[2:], det[:, :4], img0.shape).round()

# 绘制边界框

for *xyxy, conf, cls in reversed(det):

label = f'Person: {conf:.2f}'

plot_one_box(xyxy, img0, label=label, color=(0, 255, 0), line_thickness=2)

# 显示图像

cv2.imshow('Pedestrian Detection', img0)

if cv2.waitKey(1) & 0xFF == ord('q'): # q to quit

break

cap.release()

cv2.destroyAllWindows()

# 调用函数

detect_people_in_video()分析

这段代码首先加载了预训练的YOLOv5模型,然后对视频流的每一帧进行处理:转换图像格式、预处理、推理、非最大抑制(NMS)处理预测框,最后在原图上绘制出检测到的行人边界框。通过这个简单的项目,你可以直观地看到目标检测算法在实际场景中的应用效果。

请注意,实际应用中可能需要根据具体需求调整模型参数、检测阈值等,以及处理不同来源的视频流或图像数据。此外,对于生产环境部署,还需考虑性能优化、资源管理等问题。

目标检测算法正推动着许多革命性的应用,它的进步为我们打开了一扇认知计算的新窗口,让机器更好地理解这个世界,也让我们得以预见未来智能化生活的无限可能。欢迎踏上目标检测的学习之旅,发现更广阔的AI世界!

人工智能相关文章推荐阅读:

1.【深度学习】python之人工智能应用篇--跨模态生成技术

2.【深度学习】Python之人工智能应用篇——音频生成技术

3.【自然语言处理】python之人工智能应用篇——文本生成

4.【机器学习】python之人工智能应用篇--游戏生成技术

5.【人工智能】python之人工智能应用篇--数字人生成技术